怎样才能不造出一个“奥创”?(图)

《复仇者联盟2:奥创纪元》上映了。在这部电影里,人工智能“奥创”背叛了人类,差点把所有人都干掉了----不过安心,剧透到此为止。

【我能说奥创的人设真难看吗……图片来源:复仇者联盟2海报】

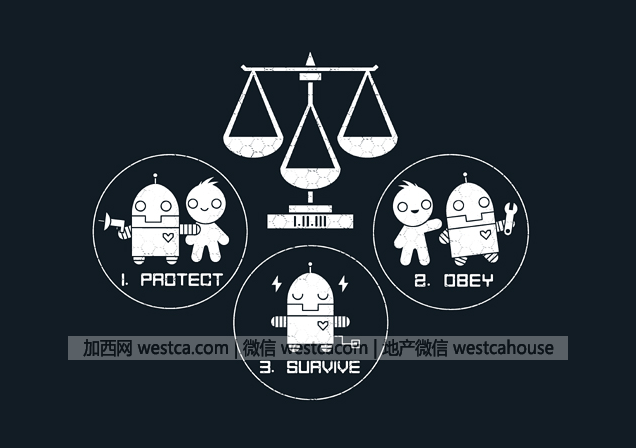

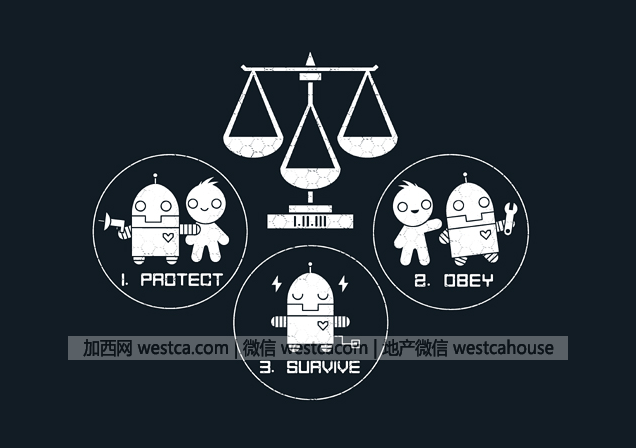

【机器人三定律的概括版。图片来源:infinitywave】

【也许这个世界最终会重新诞生出智能----但是一切将围绕回形针展开。图片来源:thoughtinfection.com】

AI造反实在是美漫和科幻里面太常见的主题了。麻烦在于,现实当中真正的AI好像也在一步步向我们走来。要是我们真的做出AI,它又造反了,怎么办?能不能安排好预防措施,让它永远忠诚于我们,永远不会把我们都干掉呢?

机器人三定律?你想少了

许多科幻迷都会记得阿西莫夫的机器人三定律:

•机器人不得伤害人,亦不得因不作为而致人伤害。

机器人必须遵循人的命令,除非违背第一定律。

机器人必须保护自己,除非违背第一或第二定律。

看起来这似乎足够保护人类了,其实完全不行。

首先,三定律翻译成“定律”就是个错误。牛顿三定律是人类对自然界观察总结后提炼出来的结果,我们有理由相信在它适用的范围内是始终成立的;但是阿西莫夫三“定律”实际上只是三法条,是人为写进机器人的脑子里的,背后并没有任何物理支持。任何理解机器人如何运作的人都能造出不遵从三定律的机器人,这还不算机器人自己故障的可能性;事实上阿西莫夫自己就写过至少3个不遵循定律的例子。

然后,这三定律连“人”和“机器”的定义都没有明确给出……阿西莫夫笔下的索拉利亚人就给他们的机器人规定“只有带索拉利亚口音的才是人”。人形机器人也会带来各种判断的麻烦。(这又引出三定律的另一个问题,如果机器人没有掌握充分信息,不能意识到行为的后果,是不是就可以恣意妄为了?)

您的点赞是对我们的鼓励

您的点赞是对我们的鼓励

还没人说话啊,我想来说几句

还没人说话啊,我想来说几句

【我能说奥创的人设真难看吗……图片来源:复仇者联盟2海报】

【机器人三定律的概括版。图片来源:infinitywave】

【也许这个世界最终会重新诞生出智能----但是一切将围绕回形针展开。图片来源:thoughtinfection.com】

AI造反实在是美漫和科幻里面太常见的主题了。麻烦在于,现实当中真正的AI好像也在一步步向我们走来。要是我们真的做出AI,它又造反了,怎么办?能不能安排好预防措施,让它永远忠诚于我们,永远不会把我们都干掉呢?

机器人三定律?你想少了

许多科幻迷都会记得阿西莫夫的机器人三定律:

•机器人不得伤害人,亦不得因不作为而致人伤害。

机器人必须遵循人的命令,除非违背第一定律。

机器人必须保护自己,除非违背第一或第二定律。

看起来这似乎足够保护人类了,其实完全不行。

首先,三定律翻译成“定律”就是个错误。牛顿三定律是人类对自然界观察总结后提炼出来的结果,我们有理由相信在它适用的范围内是始终成立的;但是阿西莫夫三“定律”实际上只是三法条,是人为写进机器人的脑子里的,背后并没有任何物理支持。任何理解机器人如何运作的人都能造出不遵从三定律的机器人,这还不算机器人自己故障的可能性;事实上阿西莫夫自己就写过至少3个不遵循定律的例子。

然后,这三定律连“人”和“机器”的定义都没有明确给出……阿西莫夫笔下的索拉利亚人就给他们的机器人规定“只有带索拉利亚口音的才是人”。人形机器人也会带来各种判断的麻烦。(这又引出三定律的另一个问题,如果机器人没有掌握充分信息,不能意识到行为的后果,是不是就可以恣意妄为了?)

| 分享: |

| 注: | 在此页阅读全文 |

怎样才能不造出一个“奥创”?(图)

怎样才能不造出一个“奥创”?(图)